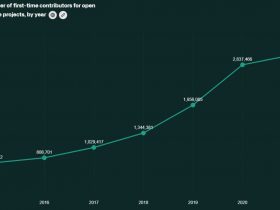

Lançado no final de junho, o GitHub Copilot é uma ferramenta que usa o Codex, o novo sistema de IA criado pela OpenAI, para permitir que os desenvolvedores economizem tempo sugerindo linhas de código e funções inteiras instantaneamente. Este novo assistente de codificação está fazendo com que muita tinta flua. Em questão: questões sobre os direitos autorais dessas linhas de código geradas automaticamente, mas também sobre a justiça de tal abordagem dentro da comunidade de código aberto.

Questões de justiça, legitimidade e legalidade

Treinado usando aprendizado de máquina de grandes corpos de trabalho disponíveis publicamente, o GitHub Copilot recebeu fortes reações de desenvolvedores, mas também da Free Software Foundation (FSF). A organização sem fins lucrativos americana, cuja missão é promover e defender o software livre, recomenda que os desenvolvedores não hospedem seu código na plataforma por questões de direitos autorais. A FSF acredita que o assistente “ como é inaceitável e injusto ”. Principal reclamação contra a solução desenvolvida pelo GitHub: ” requer a execução de software que não é gratuito (Visual Studio ou partes do Visual Studio Code) oferecer um serviço que substitua o software, reutilizando o código-fonte público com possíveis usos comerciais, sem uma licença apropriada.

De acordo com a FSF, o uso do Copilot levanta questões de justiça, legitimidade e legalidade, que ainda não foram avaliadas e que exigiriam uma análise cuidadosa, com possíveis implicações legais.

Podemos ver que o uso de software licenciado livremente pela Copilot tem muitas implicações para uma grande parte da comunidade de código aberto. Os desenvolvedores querem saber se treinar uma rede neural em seu software pode realmente ser considerado uso justo. Outras pessoas que podem estar interessadas em usar o Copilot estão se perguntando se trechos de código e outras coisas copiadas dos repositórios hospedados no GitHub podem levar à violação de direitos autorais. E mesmo que tudo pudesse ser copiado legalmente, os interessados se perguntam se não há algo fundamentalmente injusto no fato de um editor de software proprietário construir um serviço a partir de seu trabalho, explica a FSF em comunicado.

A posição do GitHub sobre reivindicações de violação de direitos autorais

Diante de acusações de violação de direitos autorais, inclusive “ lavagem de código ” compartilhada via redes sociais, a plataforma de desenvolvimento de propriedade da Microsoft remete aos elementos presentes em seu FAQ . A saber: “ O GitHub Copilot é um sintetizador de código, não um mecanismo de busca: a grande maioria do código que ele sugere é gerado exclusivamente e nunca foi visto antes. Descobrimos que cerca de 0,1% das vezes a sugestão pode conter trechos de texto do conjunto de treinamento. »

Segundo o GitHub, esses casos surgem quando os desenvolvedores não fornecem contexto suficiente em sua solicitação, ao editar um arquivo vazio ou ” quando há uma solução comum, até universal, para o problema “. Ele ainda acrescenta: “ Estamos em processo de implementação de um sistema de rastreamento de origem para detectar os raros casos em que o código é repetido a partir do conjunto de dados de treinamento, para ajudá-lo a tomar boas decisões em tempo real sobre as sugestões oferecidas pelo GitHub Copilot ”.

Uma chamada para white papers para responder a perguntas de desenvolvedores

Em resposta às muitas solicitações recebidas pela fundação, ela acaba de lançar uma chamada financiada para white papers sobre o uso do GitHub Copilot, direitos autorais, aprendizado de máquina e, mais amplamente, software de código aberto. O objetivo: responder a questões colocadas pela comunidade e “ identificar as melhores oportunidades para defender a liberdade dos utilizadores neste espaço ”.

- O treinamento do Copilot em repositórios públicos infringe direitos autorais? Isso é uso justo?

- Como os desenvolvedores podem garantir que qualquer código que possuam seja protegido por direitos autorais de violações geradas pelo Copilot?

- Existe uma maneira de os desenvolvedores que usam o Copilot cumprirem licenças de software livre como a GPL?

- Se o Copilot gerar um código que infrinja um trabalho licenciado de software livre, como essa violação pode ser descoberta pelo detentor dos direitos autorais do trabalho subjacente?

- O modelo de IA/ML treinado pelo Copilot é protegido por direitos autorais? Em caso afirmativo, quem possui esses direitos autorais?

Esses white papers e as respostas a essas perguntas são particularmente aguardados, em particular para esclarecer legalmente o problema de direitos autorais levantado pelo Copilot. De forma mais geral, o assistente de programação desenvolvido pelo GitHub destaca a necessidade do framework necessário para o uso deste tipo de software gerado a partir de código fonte público.